Chcesz porozmawiać na temat naszego wsparcia?

Zostaw nam wiadomość

Zazwyczaj odpowiadamy w ciągu kilku godzin. Możesz również umówić się z nami na konkretny termin rozmowy klikając na poniższy link do naszego kalendarza.

Na kod binarny, czyli system zapisu matematycznego, podobny do systemy dziesiętnego, którym posługujemy się na codzień, udało nam się przetłumaczyć takie odczucia zmysłowe jak: kolor, dźwięk, obraz (statyczny i wideo). Czy maszyna może odczytywać uczucia ludzkie ?

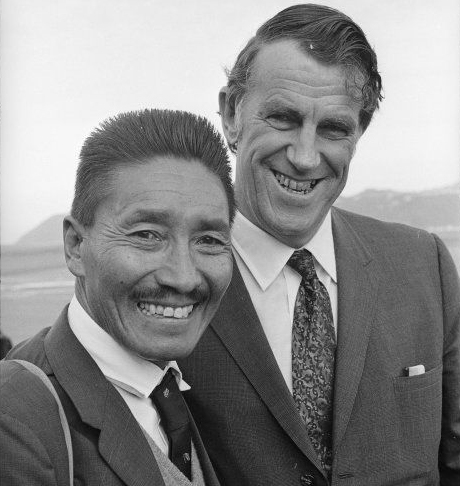

Rosalind Picard, profesor Massachusetts Insititute of Technology (MIT), stworzyła pojęcie „affective computing” publikując w 1995 roku książkę o takim tytule. Jest to obszar nauki, który bada jak komputery mogą rozpoznawać ludzkie uczucia, tak aby usprawnić interakcję pomiędzy człowiekiem a komputerem.

Wybitny futurolog Yuval Noah Harari podaje stwierdza w swojej książce „21 lekcji na 21 wiek”: uczucia nie są jakimś mitycznym zjawiskiem, emocje ludzkie są wynikiem procesu biochemicznego. Są zatem czymś fizycznym. Wydaje się, że w nie tak dalekiej przyszłości algorytm AI będzie zdolny analizować dane biometryczne dostarczane przez sensory rozmieszczone wewnątrz i na zewnątrz ludzkiego ciała. Taka aplikacja byłaby z czasem zdolna kategoryzować człowieka pod kątem jego profilu osobowościowego oraz rozpoznawać zmiany nastroju.

W dalszej przyszłości możemy wg Harariego prognozować aplikacje, które potrafią ocenić wpływ muzyki czy filmu na nasze emocje i podpowiadać nam np. muzykę, która jest nas w stanie uspokoić w określonej sytuacji stresowej biorąc pod uwagę, że aplikacja rozumie naszą osobowość.

Co się natomiast stanie, jeżeli z wyżej opisanej aplikacji zaczną korzystać politycy ? Czy będą w stanie tworzyć dopasowane indywidualnie do naszego profilu osobowościowego materiały wyborcze ? Co się stanie, jeżeli w kraju autorytarnym jak na przykład Chiny czy Rosja, aplikacja będzie w stanie podpowiadać autorytarnemu rządowi jakie emocje wyzwala w konkretnym obywatelu kierowana do niego propaganda, na przykład odczytując mimikę twarzy ?

Co się stanie, jeżeli technologia rozpoznawania emocji i dopasowania do nich odpowiednich treści, zostanie wykorzystana przez wielkie korporacje ? Załóżmy, że duża firma odzieżowa może manipulować w sposób naukowy emocjami swoich klientów (np. w materiałach rozprowadzanych listą mailingową) wywołuje celowo uczucie smutku, tak aby klient chciał poprawić sobie nastrój zakupami ?

Czy skończy się era wolnej woli i wolnego wyboru ?

Jak daleko technologicznie jesteśmy od takiego stanu rzeczy ?

Poniżej link do ciekawego wywiadu z Rosalind Picard

https://www.youtube.com/watch?v=kq0VO1FqE6I

Założona przez Picard firma Affectiva (www.affectiva.com) opracowała technologię, która jest w stanie zmierzyć puls człowieka wyłącznie na podstawie obrazu wideo, bez żadnego urządzenia sendorycznego. Oferowana przez Affectiva technologia Affdex pozwala na odczyt z mimiki twarzy określonych ludzkich emocji takich jak zdzwienie, radość czy koncentracja. Z oprogramowania korzysta m.in. Mars i sieć telewizyjna CBS.

Według Picard, z jednej strong jesteśmy cały czar moon ograniczeni w tym co możemy wyczytać z ludzkiej twarzy, z drugiej strony jest to o wiele więcej niż większość z nas ma świadomość. Posiłkując się jedynie zwykłą kamera w laptopie, czy smartfonie, widzimy, czy puls człowieka przyspiesza, czy oddychanie zaczyna być nieregularne, możemy zobaczyć zmiany koloru skóry, których człowiek nie jest w stanie zauważyć, natomiast kamera jest w stanie. „Cały czas aplikacja nie wie z pewnością jak tak naprawdę się czujesz, niemniej na podstawie ruchów twojego ciała, nawet minimalnych, aplikacja jest w stanie przewidzieć jak się czujesz emocjonalnie z bardzo dużym prawdopodobieństwem”.

Zresztą sprawdźcie sami- poniżej bardzo fajny link do demo jak działają produkty Affectiva:

https://demo.mr.affectiva.com/

Poniżej kilka ciekawych przykładów „affective somputing” z ostatnich lat, pozbieranych na TechCruch.

Humanyze (www.humanyze.com)- software monitorujący interakcję pracowników i ich wpływ na siebie wzajemnie, używany m.in. przez Bank of America. Humanyze oferuje inteligentne „plakietki”, które zawierają bluetooth, mikrofon, akcelerometr pozwalające zbierać daneI: jak pracownicy poruszali się w ciągu dnia, z kim wchodzili w interakcje, jaki mieli ton głosu, czy bardziej mówili czy słuchali oraz wiele innych typów interakcji międzyludzkich w miejscu pracy. Inteligentny badge generuje około 4gb danych dziennie, które przesyłane są do aplikacji w chmurze i kategoryzowane na 40 typó danych, które mają wpływ na 6 głównych mierników jak np. zaangażowanie. Humanyze zastrzega, że pracodawca widzi dane wyłącznie zbiorcze, indywidualne dane widoczne są jedyni dla osoby, której pomiar dotyczy.

RealEyes (www.realeyes.com)- Brytyjski start-up, który przez kamerę analizuje reakcje emocjonalne człowieka na video, nawet tak krótkie jam 6 sekund. Oferuje również narzędzie analizy predykcyjnej dostarczające wskazówki co do efektywności przekazu video.

cogitocorp.com- analizuje w czasie rzeczywistym ton głosu osoby i podpowiada jak modulować głos- do zastosowania w obsłudze klienta.

EQ Radio- projekt badawczy, który rozpoznaje emocje za pomocą fal radiowych

Na TechCrucnch Disrupt w grudniu 2019 w Berlnie osobiście poznałem założycieli bardzo ciekawego start-upu retorio.com. Jest to narzędzie do video interview połączone z analityką mimiki twarzy, która pozwala rozpoznać szczerość odpowiedzi kandydatów, a co za tym idzie ich profil osobowościowy i dopasowanie do kultury organizacyjnej pod kątem „miękkim”.

Możemy jednak spojrzeć na „affective computing” z drugiej strony medalu- ucząca się aplikacja rozpoznająca ludzkie emocje może na przykład dotrzymywać towarzystwa osobie samotnej, dopasowując się emocjonalnie do jej potrzeb, tworząc idealnie dobranego awatara-kompana. Coś na kształt postaci literackiej w książce, od której nie można się oderwać

Wg Roz Picard, aplikacje takiej Apple Siri na podstawie tonu głosu mogą rozpoznawać z bardzo dużym prawdopodobieństwem prawdziwe tendencje samobójcze i odróżniać je od komunikatów samobójczych, kiedy osoba np. z depresją usiłuje zwrócić jedynie na siebie uwagę. Rozpoznawanie emocji przez AI może więc pomóc ratować życie.

Zazwyczaj odpowiadamy w ciągu kilku godzin. Możesz również umówić się z nami na konkretny termin rozmowy klikając na poniższy link do naszego kalendarza.